كشفت باحثة في الذكاء الاصطناعي أن ذوي البشرة السمراء تم إقصاءهم من البيانات التي جرى تدريب الذكاء الاصطناعي عليها لاستخدامها في السيارات ذاتية القيادة مما تسبب بحوادث دهس لأشخاص من ذوي البشرة السمراء، وذلك لأن هيئة المشاة الذين يقطعون الطريق في البيانات التي تم تدريب البرنامج عليها، هي دوما من البيض وتخلو من ذوي البشرة السمراء والأقليات الأخرى.

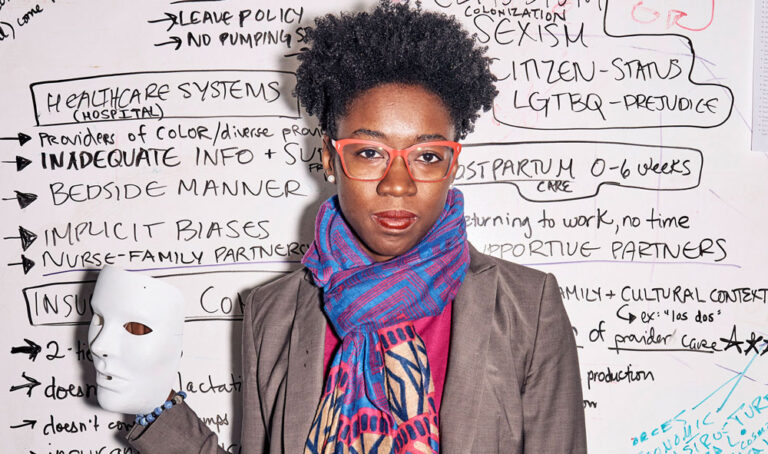

كما أظهرت الباحثة جوي بولمويني، وهي مؤسسة منظمة لمواجهة التحيز الخوارزمي في أنظمة الذكاء الاصطناعي، أن الروبوتات في مختبر زارته لم تتعرف على وجودها كليا لأنها سمراء البشرة، مما اضطرها لارتداء قناع أبيض للتعامل مع تلك الروبوتات بحسبتقرير لجامعة ماساتشوستس. وتلفت جوي إلى اعتماد أنظمة التعرف على الوجه على بيانات تركز على الرجل الأبيض لدى الشرطةالأمريكية مما يضع ذوي البشرة السمراء في مواقف خطرة لأن البرامج ستحددهم على أنهم يثيرون الشبهة دائما.

وقام جون أوليفر وهو كوميدي يقدم برنامجا ساخرا مؤخرا -لاست ويك تونايت– بلفت النظر إلى ما يسمى الصندوق الأسود في الذكاء الاصطناعي، ويراد به غموض النتائج الغريبة التي يقدمها دون تبرير منطقي أحيانا والتي تشي بخفايا البيانات التي تدربت عليها أدوات الذكاء الاصطناعي مع تقديمها نتائج متحيزة وعنصرية تكرر من خلالها أسوأ ما في الانترنت من محتوى ضار وخطير، والتي تغلب القيود التي يضعها المبرمجون للبرامج لمنع التحيز.

دعا أوليفر إلى معالجة مشكلة الصندوق الأسود ، حيث “يجب أن تكون أنظمة الذكاء الاصطناعي قابلة للتفسير ، مما يعني أننا يجب أن نكون قادرين على فهم بالضبط كيف ولماذا يقدم الذكاء الاصطناعي إجاباته تلك.” الأمر الذي قد يتطلب فرض الشفافية على شركات الذكاء الاصطناعي ؛ وأشار إلى إرشادات الاتحاد الأوروبي التي تعمل على تصنيف مخاطر برامج الذكاء الاصطناعي المختلفة ، والتي تبدو “بداية جيدة” لمعالجة المخاطر المحتملة المرتبطة بالذكاء الاصطناعي. فهناك أدوات خطيرة وحيوية مثل تلك التي يترتب عليها خطر الموت، أو حتى التوظيف، في أدوات الذكاء الاصطناعي.

واختتم قائلاً: ” يتمتع الذكاء الاصطناعي بإمكانات هائلة ويمكنه القيام بأشياء عظيمة”. “ولكن إذا كان أي شيء مثل معظم التطورات التكنولوجية على مدى القرون القليلة الماضية ، وما لم نتوخى الحذر الشديد ، فقد يؤذي أيضًا المحرومين ، ويثري الأقوياء ويوسع الفجوة بينهم.”